从旗舰级 H200 到高性价比 RTX 4090,覆盖训练、推理、渲染全场景。按需选择,灵活配置。

核心参数

8卡高端GPU集群|最高1128GB显存|高速互联|NVMe存储|100G/200G网络

推荐配置

双路CPU|1TB-2TB内存|NVMe数据盘|公网IP/专线/VPC可选

典型使用场景

千亿级大模型训练 LLM微调 长上下文推理 科学计算 复杂仿真

核心参数

大显存推理GPU|多卡可扩展|高并发推理|NVMe存储|公网/内网接入

推荐配置

1卡/2卡/4卡/8卡可选|64C-224C CPU|512GB-2TB内存|NVMe数据盘|带宽可升级

典型使用场景

大模型推理 RAG知识库 AI Agent 智能客服 API推理服务

核心参数

高性能训练GPU|80GB大显存|多卡并行|分布式训练|高速存储

推荐配置

1卡/2卡/4卡/8卡可选|32C-192C CPU|256GB-1TB内存|NVMe数据盘|高速内网

典型使用场景

深度学习训练 模型微调 CV/NLP训练 科研实验 多卡分布式训练

核心参数

48GB专业图形GPU|AI推理|图形渲染|视频生成|高性能视觉计算

推荐配置

1卡/2卡/4卡/8卡可选|高主频CPU|128GB-512GB内存|NVMe数据盘|图形环境可预装

典型使用场景

AIGC创作 Stable Diffusion ComfyUI 3D渲染 虚拟拍摄 数字孪生

核心参数

高性能消费级GPU|训练推理兼顾|AIGC适配|多卡可选|成本更优

推荐配置

1卡/2卡/4卡/8卡可选|16C-64C CPU|64GB-512GB内存|NVMe数据盘|公网IP可选

典型使用场景

中小模型训练 LoRA微调 AI绘画 视频生成 算法开发 渲染测试

核心参数

国产AI加速卡|大模型训练推理|私有化部署|数据本地化|合规适配

推荐配置

单机多卡可选|高核心CPU|大容量内存|高速数据盘|专属网络环境

典型使用场景

国产大模型训练 政企私有化部署 信创项目 行业模型适配 数据本地化计算

为不同领域提供定制化的算力方案

支持单卡验证、多卡训练、分布式并行和长周期任务运行,适配从模型微调到大模型训练的不同阶段。

推荐GPU:

大模型预训练 全参微调 LoRA微调 多卡分布式训练

支持主流AIGC环境部署,适配AI绘画、视频生成、数字人、图像增强等创作任务。

推荐GPU:

Stable Diffusion ComfyUI 文生图 文生视频 创意内容生产

支持目标检测、图像分割、OCR识别、瑕疵检测等训练与推理任务,适配工业质检和视频分析场景。

推荐GPU:

工业质检 安防识别 图像分析 视频结构化 视觉算法训练

结合GPU、CPU集群和高速存储,支持批量数据处理、并行计算和复杂工程仿真。

推荐GPU:

大规模数据分析 仿真计算 工程建模 高性能并行任务

面向研发团队代码大模型推理环境,支持企业内部代码助手、研发知识库、代码审查和自动化脚本生成。

推荐GPU:

私有化代码助手 代码补全 研发问答 代码审查 自动化脚本生成

面向高校、科研机构和实验室,支持按课题、按学生、按项目灵活分配算力资源。

推荐GPU:

分子模拟 气象计算 论文复现 算法实验 教学训练

中国超过200家五百强企业信赖海域云

多种GPU卡型结合高速网络存储,从模型训练到推理部署,适配不同场景需求,提供充沛且无卡顿的算力输出

依托成熟的分布式数据中心集群资源, 99.9% 级别高可用保障,让长周期训练任务也能安心

根据业务量动态增减GPU数量,按项目租赁,需要多少开多少,无需长期投入,彻底告别算力闲置与资源错配

打破一次性数百万的采购门槛,按小时/天精细计费,将重资产转化为轻量级运营成本,中小企业也能用上高算力

内置主流 AI 全栈环境,即开即训;省去数天的环境搭建期,提供全程技术支持。

独享 GPU 物理级/虚拟化隔离,数据传输全链路加密,实例释放后磁盘自动擦除。

提供私有网络 VPC 隔离、安全组策略与精细化权限管理,轻松应对企业合规要求。

7×24 小时技术团队在线,专属技术群 + 工单系统,故障快速响应,平均响应 < 5 分钟。

覆盖工业制造、科研机构、AI企业、渲染团队、中小科技企业

客户痛点

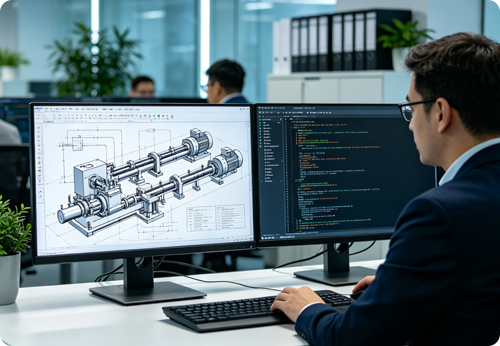

人工图纸编程效率低、易出错。

解决方案

提供GPU集群算力租用,按季度包月,配套专属运维,适配编程场景。

实际效果

编程效率提升85% 每月节省60%硬件及运维成本

每月节省60%硬件及运维成本 生产进度提前15天

生产进度提前15天

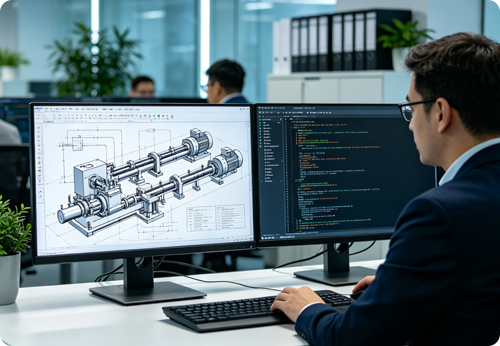

客户痛点

公司转型做虚拟拍摄,实时渲染算力要求高。

解决方案

GPU高算力租赁,按天/项目计费。

实际效果

渲染延迟降至0.1秒内 节省90%硬件采购成本

节省90%硬件采购成本  提升项目承接能力

提升项目承接能力

客户痛点

科研经费有限,无法采购高端算力设备,学生都要用。

解决方案

提供科研专用算力租赁,按月租用,每个学生按需开实例配套技术指导。

实际效果

运算效率提升70% 节省80%硬件成本

节省80%硬件成本 助力快速产出科研成果

助力快速产出科研成果

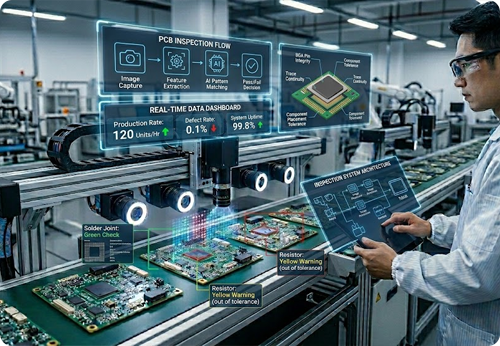

客户痛点

产品瑕疵品检测效率低,人工检测易漏判,影响订单交付。

解决方案

定制化算力租用,适配产品瑕疵检测场景,按项目计费,提供数据安全保障和7×24小时技术支持。

实际效果

瑕疵检测效率提升80%  漏判率降至0

漏判率降至0 节省55%硬件运维成本

节省55%硬件运维成本

客户痛点

公司在做垂直领域大模型微调,之前自建 8卡 H100,电费和运维成本远超预期。

解决方案

迁移我司后,按需用到 32 卡,训练周期从 2 周缩到 3 天,总成本反而降了 60%

GPU型号的选择并不困难,海域云平台上提供的GPU型号很多,对于常用的深度学习模型,根据GPU对应精度的算力可大致推算GPU训练模型的性能。

比如:

NVIDIA Pascal架构的GPU,如TitanXp,GTX 10系列等。 这类GPU缺乏低精度的硬件加速能力,但却具备中等的单精度算力。适合用来练习训练小模型或调试模型代码。

NVIDIA Volta/Turing架构的GPU,如GTX 20系列, Tesla V100等。 这类GPU搭载专为低精度(int8/float16)计算加速的TensorCore, 但单精度算力相较于上代提升不大。我们建议在实例上启用深度学习框架的混合精度训练来加速模型计算。

NVIDIA Ampere架构的GPU,如GTX 30系列,Tesla A40/A100等。 这类GPU搭载第三代TensorCore。相较于前一代,支持了TensorFloat32格式,可直接加速单精度训练 (PyTorch已默认开启)。但我们仍建议使用超高算力的float16半精度训练模型,可获得比上一代GPU更显著的性能提升。

GPU的数量选择与训练任务有关。一般我们认为模型的一次训练应当在24小时内完成,这样隔天就能训练改进之后的模型。以下是选择多GPU的一些建议:

1块GPU。适合一些数据集较小的训练任务,如Pascal VOC等。

2块GPU。同单块GPU,但是你可以一次跑两组参数或者把Batchsize扩大。

4块GPU。适合一些中等数据集的训练任务,如MS COCO等。

8块GPU。经典永流传的配置!适合各种训练任务,也非常方便复现论文结果。

大量的GPU,用于训练大参数模型、大规模调参或超快地完成模型训练。

选择适当的实例类型:确保选择的实例类型具有足够的内存来满足你的训练需求。如果内存需求较高,可以考虑选择具有更大内存容量的实例类型。

优化模型和数据:尽可能地减少模型和数据的内存占用。可以尝试使用更小的模型、降低批量大小、使用更有效的数据加载和预处理技术等方法来减少内存使用量。

监控内存使用情况:定期监控实例的内存使用情况,以确保不会超出限制。可以使用实例监控工具来实时监测内存使用情况,并及时采取行动来避免意外终止。

备份和恢复训练状态:在训练过程中定期备份训练状态,以防止意外中断导致的数据丢失。这样可以在中断后快速恢复训练,并继续进行下去。 通过综合利用这些策略,可以最大程度地减少由于内存限制导致的训练中断,从而提高训练效率和可靠性。

7×24小时有运维团队值班,工作时间5分钟之内响应。

我们有非常多的经验了,会有专门的顾问指导您。

每个实例完全隔离,存储独立加密,实例释放后磁盘数据自动擦除。

可以。

已经配置完毕。

默认 100Mbps 共享带宽,可按需升级至 1Gbps 独享,支持开通公网 IP。

微信咨询

公众号

随时查看进度/优惠/通知

随时查看进度/优惠/通知